A evolução da IA generativa é uma das transformações mais rápidas da história recente. Em poucos anos, saímos de experimentos acadêmicos para sistemas capazes de gerar textos, imagens, vídeos, código e até raciocinar sobre problemas complexos.

Este artigo apresenta um panorama completo dessa trajetória, de suas origens até 2026, destacando marcos tecnológicos, empresas-chave e tendências que estão redefinindo o futuro.

Poucas revoluções tecnológicas na história humana foram tão rápidas, tão visíveis e tão profundas quanto a evolução da IA generativa. Em menos de uma década, passamos de experimentos acadêmicos com redes neurais para sistemas capazes de escrever romances, compor músicas, gerar vídeos fotorrealistas, depurar código de produção e raciocinar sobre problemas científicos que desafiaram gerações de pesquisadores.

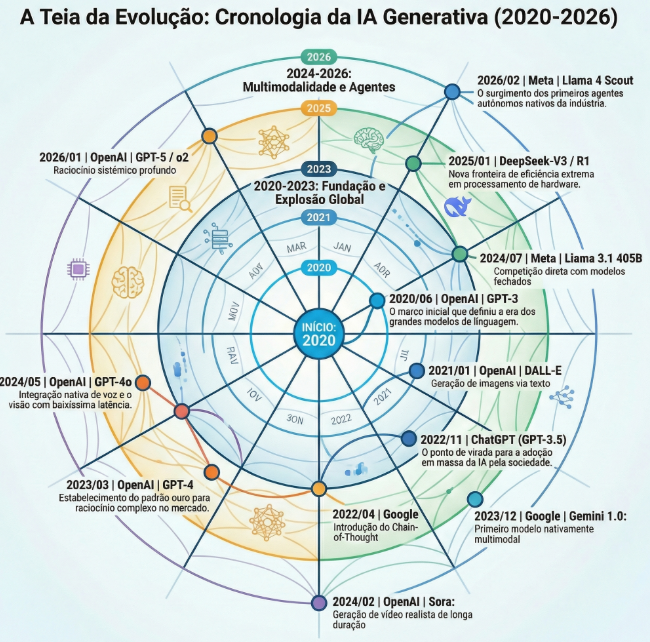

Cada anel dessa teia representa um ano. Cada nó representa um modelo. E cada cor representa uma modalidade, texto, imagem, vídeo, áudio, código, raciocínio, ciência. O que emerge não é apenas um mapa tecnológico, mas um retrato de como a evolução da IA generativa reflete a capacidade da humanidade de criar máquinas que criam.

Por que 2020?

O ano de 2020 marca um ponto de inflexão com o lançamento do GPT-3. Pela primeira vez, um modelo demonstrou capacidade consistente de gerar linguagem natural com qualidade próxima à humana em múltiplas tarefas. Esse momento consolidou a evolução da IA generativa.

Parte 1: as raízes (antes de 2020)

Para entender a evolução da IA generativa entre 2020 e 2026, é preciso compreender o terreno sobre o qual essa revolução foi construída. A IA generativa não surgiu do nada: ela é o resultado de décadas de avanços que se aceleraram de forma dramática nos anos 2010.

Os alicerces teóricos

A evolução da IA generativa não começou em 2020. Ela é resultado de décadas de pesquisa, com dois marcos fundamentais: as GANs, que possibilitaram a geração de conteúdos sintéticos realistas, e os Transformers, que revolucionaram o processamento de linguagem ao permitir maior eficiência e contex

Três anos depois, em 2017, a Google Brain publicou o artigo Attention is All You Need, introduzindo a arquitetura Transformer. Essa inovação, o mecanismo de atenção, permitiu que modelos processassem sequências inteiras de texto em paralelo, capturando dependências de longo alcance. O Transformer se tornaria a espinha dorsal de praticamente todos os grandes modelos de linguagem que viriam a seguir.

O Pré-Aquecimento: GPT-1, BERT e GPT-2 (2018–2019)

Em 2018, a OpenAI lançou o GPT-1, demonstrando que um modelo pré-treinado em grandes corpora de texto poderia ser afinado para tarefas específicas com resultados superiores. No mesmo ano, a Google apresentou o BERT, que revolucionou a compreensão de linguagem natural ao processar texto em ambas as direções simultaneamente.

Em 2019, a OpenAI lançou o GPT-2, e inicialmente se recusou a divulgar o modelo completo, citando preocupações com potencial de uso malicioso. Era um sinal de que a IA generativa havia alcançado um patamar em que suas implicações éticas e sociais precisavam ser levadas a sério. O modelo foi liberado gradualmente nos meses seguintes, e o debate sobre governança de IA havia começado.

Parte 2: o início da era (2020–2021)

Se 2018 e 2019 foram o pré-aquecimento, 2020 e 2021 foram o momento em que o motor começou a girar em velocidade alta. Dois lançamentos definiram esses anos: o GPT-3 e o DALL·E.

2020, o ano do GPT-3

O GPT-3 consolidou a ideia de modelos generalistas, capazes de executar múltiplas tarefas com alto desempenho. Seu impacto foi imediato, revelando aplicações práticas em diversas áreas e abrindo espaço para novas arquiteturas mais eficientes.

No mesmo ano, surgiram outros modelos relevantes: o GShard e o Switch-C da Google exploraram arquiteturas de Mistura de Especialistas (MoE), antecipando técnicas que seriam centrais anos depois. A plataforma 15.ai, criada anonimamente pelo MIT, demonstrou síntese de voz convincente usando poucos dados de treinamento, um dos primeiros serviços públicos de deepfakes de áudio.

| junho de 2020 | OpenAI lança GPT-3 (175B parâmetros), primeira demonstração de capacidade generalista convincente em linguagem natural. |

| outubro de 2020 | Google Brain publica o Switch Transformer, explorando arquitetura MoE com trilhões de parâmetros esparsos. |

| março de 2021 | 15.ai surge como pioneiro em síntese de voz com dados mínimos, antecipando o boom de clonagem de voz. |

2021, a IA generativa aprende a ver

2021 foi o ano em que a IA generativa ganhou olhos. Em janeiro, a OpenAI revelou o DALL·E, um modelo capaz de gerar imagens a partir de descrições textuais arbitrárias. O nome era uma homenagem ao artista Salvador Dalí e ao personagem WALL·E, da Pixar. O resultado era ao mesmo tempo impressionante e perturbador: imagens de um abacate poltrona estilo Art Nouveau ou um urso de pelúcia fazendo cirurgia cerebral saíam do modelo com qualidade surpreendente.

No mesmo mês, a OpenAI apresentou o CLIP (Contrastive Language-Image Pretraining), um modelo que aprendia a conectar textos e imagens sem supervisão explícita. O CLIP se tornaria um componente fundamental em muitos sistemas de geração e busca visual nos anos seguintes.

Em 2021, o GitHub e a Microsoft lançaram o GitHub Copilot, alimentado pelo modelo Codex da OpenAI, especializado em código. Era a primeira vez que a IA generativa chegava ao fluxo de trabalho diário de milhões de desenvolvedores de software. O Copilot não apenas completava linhas de código, mas era capaz de gerar funções inteiras a partir de comentários em linguagem natural

A Google Brain apresentou o LaMDA (Language Model for Dialogue Applications), otimizado para conversas. O modelo seria notícia em 2022 quando um engenheiro da empresa afirmaria que ele era sentiente, gerando um debate ético que revelava quão humano o comportamento desses sistemas havia se tornado.

| janeiro de 2021 | OpenAI lança DALL·E e CLIP, a IA aprende a gerar e compreender imagens a partir de texto. |

| maio de 2021 | Google Brain apresenta LaMDA, modelo conversacional que gera debate sobre consciência de IA em 2022. |

| junho de 2021 | GitHub Copilot entra em beta, a IA entra no fluxo diário de desenvolvimento de software. |

| 2021 | DeepMind apresenta Gopher (280B parâmetros); Naver lança HyperClova (82B), focado em coreano; AI21 Labs lança Jurassic-1 (178B). |

| dezembro de 2021 | Dream by Wombo é lançado, um dos primeiros apps móveis de geração de imagens acessível ao grande público |

Parte 3: a grande explosão (2022)

Se há um único ano que pode ser chamado de o momento em que tudo mudou na evolução da IA generativa, esse ano é 2022. Em doze meses, a IA generativa saiu dos laboratórios de pesquisa e entrou na consciência coletiva global. Três eventos foram decisivos: o lançamento do Stable Diffusion, o surgimento do Midjourney e, acima de tudo, o lançamento do ChatGPT.

A democracia das imagens: stable diffusion e midjourney

Em agosto de 2022, a Stability AI lançou o Stable Diffusion como software de código aberto. Pela primeira vez, qualquer pessoa com um computador razoavelmente potente podia gerar imagens de alta qualidade a partir de texto, sem depender de APIs proprietárias, sem custos por imagem, sem restrições impostas por uma corporação. O impacto foi imediato: a comunidade criativa explodiu. Em semanas, surgiram centenas de interfaces, extensões, modelos afinados e técnicas de prompting.

O Midjourney, lançado em versões beta ao longo de 2022, seguiu um caminho diferente: operado via Discord, era um serviço curado que priorizava qualidade estética. Seus resultados eram frequentemente mais artísticos que o Stable Diffusion, e a plataforma construiu uma comunidade vibrante de criadores. Até o final de 2022, o Midjourney havia alcançado milhões de usuários.

A Google respondeu com o Imagen e o Parti, modelos internos de geração de imagens com resultados impressionantes, embora de acesso restrito. O DALL·E 2, lançado em abril de 2022, trouxe melhorias significativas de resolução e qualidade em relação ao original.

O momento ChatGPT

Em 30 de novembro de 2022, a OpenAI lançou o ChatGPT como uma demonstração pública gratuita do GPT-3.5 com ajuste de instruções. O crescimento foi histórico: um milhão de usuários em cinco dias, cem milhões em dois meses, a adoção mais rápida de qualquer produto tecnológico na história. Para fins de comparação, o Instagram levou dois anos e o TikTok nove meses para atingir a mesma marca.

ChatGPT em números:

1 milhão de usuários em 5 dias, 100 milhões em 2 meses – a adoção mais rápida de qualquer produto tecnológico da história. Por comparação: Instagram levou 2,5 anos e Spotify 5 anos para a mesma marca

O ChatGPT não era tecnicamente superior aos modelos de ponta disponíveis via API. O que o tornou revolucionário foi a interface: uma conversa simples, em linguagem natural, acessível a qualquer pessoa sem conhecimento técnico. Era o primeiro sistema de IA generativa genuinamente amigável para o usuário comum, impulsionando o avanço dos chatbots com inteligência artificial nas empresas.

| abril de 2022 | OpenAI lança DALL·E 2 com qualidade e resolução superiores; entra em beta com 1 milhão de usuários na lista de espera. |

| agosto de 2022 | Stable Diffusion é lançado como open-source, democratizando radicalmente a geração de imagens por texto. |

| 2022 | Midjourney v1 a v4 são lançados via Discord, estabelecendo um novo padrão para arte gerada por IA. |

| 2022 | DeepMind lança Chinchilla (70B) e Flamingo (multimodal); Meta AI lança OPT; BigScience lança BLOOM (176B), o maior open-source da época. |

| 2022 | Google lança PaLM (540B), demonstrando emergência de novas capacidades em modelos de grande escala. |

| 2022 | OpenAI lança Whisper, sistema de reconhecimento de voz de alta precisão e multilíngue, de código aberto. |

| novembro de 2022 | ChatGPT é lançado. 1 milhão de usuários em 5 dias. 100 milhões em 2 meses. O mundo muda |

Parte 4: a corrida armamentista (2023)

Em 2023, a evolução da IA generativa entrou em uma nova fase, marcada por competição intensa entre empresas e avanços acelerados em múltiplas frentes. A corrida pela supremacia em IA generativa mobilizou bilhões de dólares, centenas de pesquisadores e as maiores corporações do mundo. Em poucos meses, a paisagem da tecnologia foi reconfigurada de forma que não se via desde o surgimento da internet comercial.

GPT-4 e o nasciimento da IA Multimodal

Em março de 2023, a OpenAI lançou o GPT-4, e com ele estabeleceu um novo patamar para o que era possível. O modelo passou no exame da Ordem dos Advogados dos Estados Unidos no percentil 90, no LSAT no percentil 88 e demonstrou desempenho de nível humano em uma variedade de benchmarks acadêmicos. Com suporte a imagens como entrada (GPT-4V), inaugurou formalmente a era dos modelos multimodais acessíveis ao público.

A Anthropic, fundada por ex-pesquisadores da OpenAI focados em segurança, lançou o Claude 1 em março de 2023 e o Claude 2 em julho. O foco em segurança e honestidade, materializado na abordagem Constitutional AI, diferenciava a Anthropic no mercado emergente de assistentes de IA.

A resposta do Google e a guerra dos chatbots

A Google, inicialmente pega de surpresa pelo sucesso do ChatGPT, lançou o Bard em fevereiro de 2023, com uma estreia problemática que incluiu um erro factual em sua primeira demonstração pública, custando à empresa mais de 100 bilhões de dólares em valor de mercado em um único dia. Foi um

lembrete doloroso de que nenhuma empresa, por maior que seja, estava imune às limitações dos modelos de linguagem.

A Microsoft, que havia investido 10 bilhões de dólares na OpenAI, integrou o GPT-4 ao Bing e ao Microsoft 365, renomeando a suíte de ferramentas como Copilot. O movimento posicionou a Microsoft como a grande beneficiária corporativa imediata da revolução da IA generativa, com acesso privilegiado aos melhores modelos e uma plataforma de distribuição global.

A democratização dos modelos abertos

Talvez o desenvolvimento mais significativo de 2023 para o longo prazo tenha sido a proliferação de modelos de código aberto e pesos abertos. A Meta AI lançou o LLaMA 1 em fevereiro e o LLaMA 2 em julho, disponibilizando modelos com bilhões de parâmetros para a comunidade de pesquisa e, em seguida, para uso comercial.

O LLaMA desencadeou uma avalanche: em semanas, a comunidade havia criado o Vicuna, o Alpaca, o WizardLM e dezenas de outros modelos afinados. A Mistral AI, startup francesa fundada em abril de 2023 por ex-pesquisadores do Google e da Meta, lançou o Mistral 7B em setembro, surpreendendo o mercado com um modelo de 7 bilhões de parâmetros que superava o LLaMA 2 de 13B em vários benchmarks, e disponível sob licença Apache 2.0.

Em dezembro de 2023, a Mistral lançou o Mixtral 8x7B, usando arquitetura MoE, que igualava o desempenho do GPT-3.5 com uma fração do custo computacional. Era a primeira vez que um modelo de código aberto chegava perto da fronteira dos modelos proprietários.

IA para criação: imagem, vídeo e áudio

2023 também foi o ano em que a geração de imagens amadureceu. O Stable Diffusion XL trouxe qualidade muito superior ao original. O Midjourney v5 e v5.1 estabeleceram novos padrões de fotorrealismo. O DALL·E 3, integrado ao ChatGPT, tornou a geração de imagens acessível a qualquer usuário da plataforma, sem necessidade de aprender prompting avançado.

No vídeo, a Runway lançou o Gen-2, capaz de gerar clipes de vídeo a partir de texto ou imagens. A Pika Labs surgiu com o Pika 1.0, conquistando usuários com sua facilidade de uso. No áudio, a Meta AI lançou o MusicGen e o AudioCraft, modelos de geração de música open-source. A Suno AI surgiu como uma plataforma de geração de músicas completas com vocalistas sintéticos.

O momento da carta aberta:

Em março de 2023, mais de 1.000 personalidades tecnológicas, incluindo Elon Musk, Steve Wozniak e pesquisadores proeminentes, assinaram uma carta pedindo uma pausa de seis meses no desenvolvimento de sistemas de IA mais poderosos que o GPT-4. A carta não produziu o efeito desejado, mas cristalizou o debate público sobre os riscos existenciais da IA. Em maio do mesmo ano, Geoffrey Hinton, o padrinho da IA profunda, deixou o Google para poder falar livremente sobre esses riscos.

A regulação entra em cena

2023 foi também o ano em que governos do mundo todo começaram a se mover. A União Europeia avançou na aprovação do AI Act, o primeiro marco regulatório abrangente para IA do mundo, classificando sistemas por nível de risco e impondo requisitos de transparência para IA generativa. A Itália baniu temporariamente o ChatGPT por preocupações com privacidade. China, Rússia, Irã e outros países implementaram restrições.

Nos Estados Unidos, o Presidente Biden assinou uma Ordem Executiva sobre IA em outubro, estabelecendo padrões de segurança e criando obrigações de transparência para empresas desenvolvedoras de modelos de grande escala. O debate sobre copyright, processado em múltiplas ações judiciais contra OpenAI, Stability AI e outros, também ganhou força.

| Empresa | Modelos Principais (2023) | Tipo | Destaque |

|---|---|---|---|

| OpenAI | GPT-4, GPT-4V, DALL·E 3 | Texto / Imagem | Primeiro modelo multimodal de uso geral |

| Anthropic | Claude 1, Claude 2 | Texto | Foco em segurança e Constitutional AI |

| Bard, PaLM 2, Gemini 1.0 | Texto / Multimodal | Integração com busca e ecossistema Google | |

| Meta AI | LLaMA 1, LLaMA 2, Code Llama | Texto / Código | Open-source, base para ecossistema aberto |

| Mistral AI | Mistral 7B, Mixtral 8x7B | Texto | Eficiência + código aberto, rivaliza com GPT-3.5 |

| Stability AI | Stable Diff. XL | Imagem | Maior qualidade e controle para open-source |

| Runway | Gen-2 | Vídeo | Pioneiro em geração de vídeo a partir de texto |

| xAI | Grok-1 | Texto | Elon Musk entra na corrida com acesso ao X/Twitter |

Parte 5: consolidação e expansão (2024)

2024 foi o ano da consolidação: os modelos ficaram mais rápidos, mais baratos, mais capazes e mais integrados ao cotidiano corporativo e pessoal. A corrida não diminuiu, acelerou, mas o campo de competidores se expandiu e a inovação se distribuiu de forma mais ampla.

GPT-4o e a era da multimodalidade nativa

Em maio de 2024, a OpenAI lançou o GPT-4o (o de omni), um modelo que processava texto, áudio e imagens de forma nativa e integrada, sem transferências entre modelos separados. A latência de resposta de voz caiu para centenas de milissegundos, aproximando a experiência de uma conversa humana real. A demonstração ao vivo do GPT-4o resolvendo problemas de matemática enquanto ouvia um aluno e expressava emoções em sua voz gerou reações que variaram do espanto ao desconforto.

Em setembro de 2024, a OpenAI lançou o o1, um modelo de uma nova categoria: raciocínio. Ao contrário dos modelos anteriores, o o1 pensava antes de responder, gerando uma cadeia de raciocínio interna antes de produzir a resposta final. Isso resultou em desempenho dramaticamente superior em matemática (83% na Olimpíada Internacional de Matemática, contra 13% do GPT-4o) e em tarefas que exigiam lógica rigorosa.

Claude 3 e a ascensão da Anthropic

Em março de 2024, a Anthropic lançou a família Claude 3, com três variantes (Haiku, Sonnet e Opus) balanceando velocidade, custo e capacidade. O Claude 3 Opus foi o primeiro modelo a superar o GPT-4 nos principais benchmarks de referência, marcando o ponto em que a Anthropic passou de competidora emergente a líder compartilhada do mercado de alto desempenho.

Em junho de 2024, o Claude 3.5 Sonnet foi lançado, combinando o desempenho do Opus com a velocidade do Sonnet, e introduzindo o Artifacts, que permitia ao modelo gerar e executar código em tempo real. A funcionalidade transformou o Claude em uma ferramenta de desenvolvimento de software, não apenas de geração de texto.

Gemini 1.5 e a janela de contexto de 1 milhão de tokens

A Google respondeu em 2024 com o Gemini 1.5 Pro, apresentando uma janela de contexto de 1 milhão de tokens, a maior disponível comercialmente na época. Isso significava que o modelo podia processar documentos inteiros, bases de código completas, longas conversas históricas ou até horas de vídeo em uma única chamada. Era um salto qualitativo na forma como IA podia lidar com informação de longo alcance.

A explosão do vídeo e das imagens

2024 foi o ano em que a geração de vídeo deu seu grande salto. Em fevereiro, a OpenAI revelou o Sora, capaz de gerar clipes de vídeo de até 60 segundos com qualidade e coerência física impressionantes. O modelo não foi lançado publicamente de imediato, mas sua demonstração provocou reações que iam da admiração à consternação na indústria cinematográfica.

A Runway lançou o Gen-3 Alpha; o Kuaishou surpreendeu com o Kling, capaz de gerar vídeos de até dois minutos com movimentos físicos plausíveis. A Tencent apresentou o HunyuanVideo. A Lightricks lançou o LTX Video como open-source. Em imagens, a Black Forest Labs (fundada por ex-pesquisadores da Stability AI) lançou o FLUX.1, rapidamente adotado como o modelo open-source de referência para geração de imagens de alta qualidade.

DeepSeek e a surpresa chinesa

Um dos desenvolvimentos mais significativos de 2024 não veio dos Estados Unidos. A DeepSeek, startup chinesa de Hangzhou fundada em 2023, lançou o DeepSeek V2 em maio de 2024, um modelo de 236 bilhões de parâmetros com arquitetura MoE que igualava o desempenho de modelos de ponta a uma fração do custo de inferência. O DeepSeek V2.5 foi ainda melhor. A empresa demonstrou que fronteira de desempenho não era exclusividade das grandes corporações americanas.

78% das empresas globais usavam IA em 2024 (McKinsey)

US$4,4T de impacto anual potencial da IA generativa (McKinsey)

65% das empresas adotaram IA generativa até 2024

1M+ tokens de contexto no Gemini 1.5 Pro

83% do GPT-o1 na Olimpíada Internacional de Matemática

200M usuários semanais do ChatGPT em agosto de 2024

Parte 6: raciocínio, agentes e open-source (2025)

Em 2025, a evolução da IA generativa cruzou uma nova fronteira: os modelos deixaram de apenas gerar conteúdo e passaram a raciocinar, planejar e executar tarefas. O surgimento de agentes autônomos marcou essa transição.

O fenômeno DeepSeek R1

Em janeiro de 2025, a DeepSeek lançou o R1, um modelo de raciocínio que chocou o mundo por dois motivos. Primeiro, seu desempenho: igualava ou superava o o1 da OpenAI nos principais benchmarks de matemática, ciência e código. Segundo, seu custo de treinamento: aproximadamente 6 milhões de dólares, contra estimativas de centenas de milhões para modelos equivalentes americanos. As ações da Nvidia caíram 17% em um único dia, com investidores questionando se a corrida por chips de IA era mesmo necessária na escala imaginada.

O efeito DeepSeek:

O lançamento do DeepSeek R1 em janeiro de 2025 foi o maior choque do mercado de IA desde o ChatGPT. A empresa demonstrou que era possível treinar modelos de fronteira com hardware restrito por sanções de exportação americanas, usando técnicas de destilação e otimização de dados. O evento reacendeu o debate sobre a eficácia das sanções tecnológicas e sobre a sustentabilidade dos investimentos em infraestrutura de IA.

GPT-5 e a nova geração OpenAI

A OpenAI respondeu com o GPT-5, um modelo que integrava nativamente capacidades de raciocínio ao modelo base, sem necessidade de um sistema separado como o o1. O GPT-4.5, lançado antes, havia refinado a qualidade conversacional. O o3 e o o4-mini estabeleceram novos patamares de raciocínio matemático. Em 2025, a OpenAI também lançou o Sora em versão pública expandida, o GPT Store com milhões de GPTs customizados e o ChatGPT Agent, um sistema capaz de executar tarefas complexas de forma autônoma, navegando na web, escrevendo e executando código.

Claude 4 e a vanguarda da Anthropic

A Anthropic lançou o Claude 3.7 Sonnet com pensamento estendido (Extended Thinking) e, posteriormente, o Claude 4 Opus, consolidando a posição da empresa como líder em modelos de alto desempenho, especialmente para tarefas de codificação e raciocínio complexo. O Claude Code foi lançado como ferramenta de linha de comando para programação agentica, integrando o modelo ao fluxo de desenvolvimento de software de forma profunda.

Gemini 2.5 e o domínio do Google em multimodalidade

O Gemini 2.5 Pro da Google atingiu o topo de múltiplos benchmarks no início de 2025, combinando raciocínio avançado com processamento multimodal nativo. A Google lançou o Veo 3, capaz de gerar vídeos com áudio nativo sincronizado, e o Lyria 3 para geração musical de alta fidelidade. O Genie 3 demonstrou geração de ambientes 3D interativos em tempo real a partir de descrições textuais.

LLaMA 4 e a maturidade do open-source

A Meta AI lançou o LLaMA 4 como uma família de modelos nativamente multimodais, incluindo o Scout e o Maverick. Pela primeira vez, um modelo open-source de alta capacidade incluía compreensão visual nativa. Modelos como o Kimi K2 da Moonshot AI (1 trilhão de parâmetros, MoE) e o QwQ-32B da Alibaba (raciocínio puro) demonstraram que a fronteira de desempenho havia se democratizado de forma irreversível.

A era dos agentes

O desenvolvimento mais transformador de 2025 não foi um modelo específico, mas um paradigma: os agentes de IA. Sistemas capazes de decompor objetivos complexos em subtarefas e atuar de forma autônoma, dando origem ao conceito de superagentes de IA. A Gartner previu que aplicações empresariais com agentes de IA específicos para tarefas cresceriam de menos de 5% para 40% até o final de 2026.

O Claude Code, o ChatGPT Agent, o Grok Code Fast e o Gemini com Deep Think representaram diferentes abordagens para essa nova categoria. A questão já não era o modelo consegue fazer isso? mas como coordenamos múltiplos agentes para resolver problemas que nenhum modelo único pode resolver sozinho?

Parte 7: a nova fronteira (2026)

Em 2026, a evolução da IA generativa caminhou para sistemas mais autônomos e colaborativos. Os modelos passaram a operar de forma integrada, combinando diferentes modalidades e interagindo entre si para resolver tarefas complexas.

O desempenho em benchmarks atingiu níveis superiores à média humana em diversas áreas, trazendo o debate sobre inteligência artificial geral para um campo mais prático e urgente.

O debate AGI entra em campos

Em 2026, pela primeira vez, sistemas de IA alcançaram desempenho que superou a média humana em benchmarks que antes eram considerados intocáveis. Um modelo experimental da OpenAI ganhou medalha de ouro na Olimpíada Internacional de Matemática de 2025 sem ferramentas externas. O Gemini Deep Think alcançou o mesmo feito. A plataforma Poetiq, usando GPT-5.2, reportou superar significativamente a média humana no ARC-AGI-2, o benchmark criado especificamente para resistir à IA.

O debate sobre Inteligência Artificial Geral (AGI) deixou de ser filosófico e se tornou prático: o que significa uma IA ter alcançado AGI? Quais são as implicações legais, econômicas e éticas? As respostas ainda estão sendo construídas.

Parte 8: Impacto na economia, sociedade e trabalho

Os impactos da evolução da IA generativa se expandiram rapidamente. Na economia, os investimentos cresceram de forma exponencial, com potencial de impacto trilionário.

No mercado de trabalho, houve aumento de produtividade, mas também transformação nas funções e surgimento de novas especializações. Médicos, professores, advogados, escritores, estudantes e empresários já encontraram usos práticos — inclusive em aplicações de IA no atendimento ao cliente, como no setor farmacêutico.

Na indústria criativa, a tecnologia democratizou a produção, ao mesmo tempo em que intensificou debates sobre direitos autorais. No cenário geopolítico, a IA se tornou um eixo estratégico na disputa entre países.

US$145B investidos globalmente em IA no ano de 2023

+85% de crescimento dos investimentos em IA em 2025

US$4,4T de impacto anual potencial (McKinsey)

92% das organizações explorando IA generativa em 2024

US$13T de adição potencial ao PIB global até 2030 (McKinsey)

US$100B de oportunidades para a América Latina na próxima década

Parte 9: padrões, tendências e futuro

Ao analisar essa trajetória, fica claro que a evolução da IA generativa segue padrões consistentes de democratização, eficiência e expansão de capacidades. A multimodalidade se consolidou e o raciocínio emergiu como nova fronteira.

O futuro aponta para sistemas mais autônomos, aplicações científicas mais avançadas e novas formas de interação entre humanos e máquinas. Ao mesmo tempo, questões relacionadas à governança e ao uso responsável da tecnologia ganham ainda mais relevância.

A pergunta fundamental:

A IA generativa não é apenas uma tecnologia. É uma nova forma de externalizar cognição, de transferir para máquinas parte do que sempre consideramos exclusivamente humano: criar, raciocinar, comunicar, imaginar. Como qualquer ferramenta poderosa, seu impacto depende menos da tecnologia em si e mais das escolhas que fazemos sobre como, por quem e para quem ela é desenvolvida e implantada.

Conclusão

A evolução da IA generativa transformou, em poucos anos, a forma como criamos, trabalhamos e interagimos com a tecnologia. Em sete anos, de 2020 a 2026, o campo da IA generativa passou por uma transformação que, em outras tecnologias, teria levado décadas. O GPT-3, que pareceu revolucionário em 2020, tornou-se obsoleto em menos de três anos. Modelos que custavam centenas de milhões de dólares para treinar passaram a ter competidores open-source disponíveis gratuitamente.

Temos e então um mapa de uma das mais rápidas transformações tecnológicas da história humana, com consequências que ainda estamos aprendendo a compreender.

O que fica claro ao olhar para esse mapa é que não há um único centro de gravidade: há OpenAI e Anthropic e Google e Meta e Mistral e DeepSeek e dezenas de outros. Não há um único modelo dominante: há modelos para texto, imagem, vídeo, áudio, código, raciocínio, ciência. Não há uma única nação: há Estados Unidos, China, França, Reino Unido, Coreia do Sul, Emirados Árabes.

Mais do que uma inovação tecnológica, a evolução da IA generativa representa uma mudança estrutural na forma como a inteligência é produzida e aplicada.

Sobre o autor

Stênio Oliveira é head de desenvolvimento do Grupo Wiser, mestre em computação e professor de cursos de tecnologia de nível técnico e superior com vasta experiência em desenvolvimento e implementação de soluções de TI de ponta.